El reciente auge de la inteligencia artificial ha dado dividendos a Nvidia, ya que, según se informa, la compañía envió 3,76 millones de GPU para centros de datos solo en 2023. Esto es más de un millón de procesadores gráficos más de los que envió a este mercado en 2022, lo que aumentó sus ventas en más del 42%. Según HPCwire, estas cifras muestran que Nvidia ha conservado su participación de mercado del 98% en el mercado de GPU de centros de datos en 2023 respecto al año anterior.

Además de su liderazgo en el mercado de centros de datos, Nvidia también ha acaparado el 88% del mercado de GPU de escritorio, y se espera que la serie RTX 50 de próxima generación llegue a finales de este año. Debido a esta demanda masiva, la compañía ha experimentado un crecimiento récord, con Nvidia alcanzando $60,9 mil millones en ingresos en 2023, un 126% más que en 2022.

Hemos visto este crecimiento a pesar de la prohibición estadounidense de las exportaciones de inteligencia artificial y otros chips avanzados de Nvidia a China. Además, la empresa todavía tenía que lidiar con la escasez de GPU de IA, ya que la producción de TSMC no podía seguir el ritmo de la demanda.

Sin embargo, TSMC predijo que Nvidia se convertirá en la empresa de semiconductores más grande del mundo en 2023. A partir del 24T1, Nvidia ya ocupa el tercer lugar entre las empresas más valiosas del mundo y probablemente pronto superará a Apple.

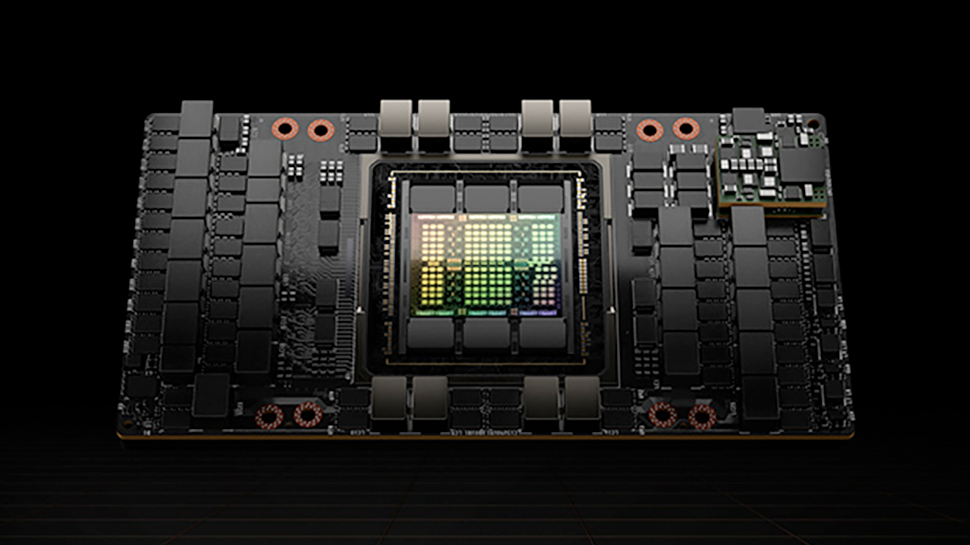

Pero incluso si Nvidia ha acaparado el mercado de los centros de datos, no puede dormirse en los laureles. AMD está en camino de ofrecer chips mucho más eficientes energéticamente, algo con lo que la GPU H100 de Nvidia está teniendo problemas, ya que consume 700 vatios cuando funciona a su máxima capacidad. Intel también está promocionando su procesador Gaudi 3 AI, que costará la mitad del precio del H100: una oferta tentadora para las empresas que no quieren gastar más de 30.000 dólares por una tarjeta H100.

Aparte de las típicas empresas de semiconductores, también vemos que los proveedores de centros de datos se unen a la carrera de hardware de centros de datos. Microsoft reveló el año pasado la GPU Maia 100, que creó para aplicaciones de inteligencia artificial, y es probablemente uno de los chips que utilizará en su próximo proyecto de centro de datos de 100 mil millones de dólares. Incluso Amazon y Google tienen sus propios chips de cosecha propia: el primero fabrica chips personalizados para AWS y el segundo planea utilizar sus propios procesadores de servidor de centro de datos a partir del próximo año.

Sin embargo, Nvidia afirma que estos chips aún no son tan potentes como sus GPU en cuanto a rendimiento de IA. Tampoco serán tan adaptables. Entonces, aunque otras empresas puedan ofrecer alternativas a Nvidia, las GPU de la compañía probablemente se mantendrán en la cima en los próximos años.